一、开篇引入

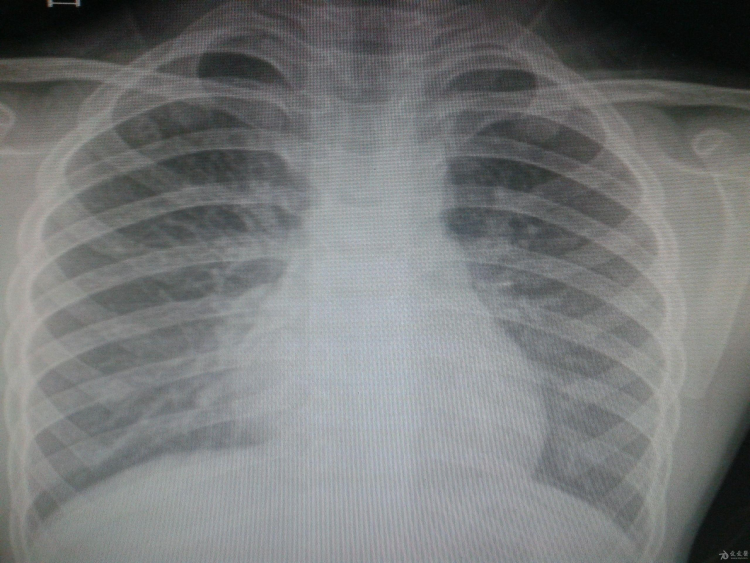

医学影像分析是人工智能在医疗领域落地最成熟、应用最广泛的方向之一,而胸部X光片(Chest X-Ray, CXR)作为全球每年使用量最大的影像学检查手段,自然成为AI诊断助手率先攻克的“主战场”。从2025年底到2026年初,以AFLoc、Ark+、MCADS为代表的新一代AI模型密集发布,AI诊断助手胸片技术的核心范式正在经历从“依赖手工标注”向“自监督学习”的深刻转型。许多学习者在接触这一领域时,往往存在“只会调用现成模型、不懂底层架构原理、混淆分类与分割任务、面试答不出技术链路”等痛点。本文将系统讲解AI胸片诊断的技术全貌:从为什么需要AI辅助诊断、核心算法模型的选择逻辑,到完整的系统架构设计与代码实现,最后梳理高频面试考点,帮助读者建立从概念到落地的完整知识链路。

二、痛点切入:为什么需要AI辅助诊断?

传统实现方式

在没有AI辅助的传统诊断流程中,放射科医生需要逐张阅片,用肉眼识别病灶。气胸的视觉特征仅仅是一条细微的胸膜线,肺结节的早期表现更是极不明显-25。以下是一个传统“硬编码”思路的伪代码示意:

传统基于规则的病灶检测(伪代码) def detect_pneumothorax(image): 基于像素阈值的边缘检测 edges = canny_edge_detection(image, threshold=预设值) pleural_line = find_pleural_line(edges) if pleural_line is None: return "无法判断" if line_thickness < 预设阈值: return "疑似气胸" else: return "无气胸"

痛点分析

这种传统方法的缺陷非常明显:规则僵化,不同设备的成像参数、患者的体型差异都会导致预设阈值失效;准确率低,早期病变特征极不明显,肉眼极易漏诊——meta分析显示,常规胸片解读会遗漏相当比例的早期肺癌病灶-69;效率瓶颈突出,全球放射科医生短缺导致报告周转时间拉长,部分基层医疗机构甚至无力配备专职放射医师-2。AI辅助诊断正是为解决这些痛点而生的。

三、核心概念讲解:深度学习驱动的医学影像分析

CNN(卷积神经网络)——AI“看懂”胸片的核心引擎

标准定义:Convolutional Neural Network(CNN,卷积神经网络),是一种专门用于处理网格结构数据(如图像)的深度学习模型,通过卷积核在图像上滑动提取局部特征,逐层抽象出高级语义信息。

通俗理解:CNN之于医学影像,就像放大镜之于侦探。第一层卷积“看”到的是边缘、纹理等底层特征;中间层开始组合成气管、肋骨等解剖结构;深层则能识别出结节、积液等病灶特征。在胸片诊断任务中,DenseNet121因其高效的参数利用和特征复用能力,成为许多工业级AI诊断助手的基础骨干网络-2。

多标签分类与定位——一张胸片可能藏着多种疾病

一张胸片上往往同时存在多种异常——可能是肺炎合并胸腔积液,也可能是肺结节与气胸并存。这就是多标签分类任务的核心挑战:模型需要同时判断是否存在多种疾病(不是单选题,而是多选题)。CheXNet等模型正是在NIH ChestX-ray14数据集上训练,该数据集包含超过10万张正面胸片,标注了多达14种疾病类别-38。

四、关联概念讲解:病灶定位与分割

如果说分类是回答“有没有病”,那么定位和分割就是回答“病在哪里”。

语义分割——像素级的病灶刻画

标准定义:Semantic Segmentation(语义分割),为图像中的每个像素分配一个类别标签(如“肺区域”“病灶区域”“背景”),从而精确勾勒出病变的边界和范围。在医学影像分析中,U-Net及其变体是目前最主流的语义分割架构-25。

Grad-CAM——AI的可解释性“热力图”

标准定义:Gradient-weighted Class Activation Mapping(Grad-CAM),通过计算模型最后一层特征图相对于目标类别的梯度,生成一张热力图,高亮显示模型做出判断时最关注的图像区域-2。

对比关系梳理:

| 对比维度 | 多标签分类 | 语义分割 |

|---|---|---|

| 输出形式 | 疾病存在与否的向量 | 像素级的类别掩码 |

| 粒度 | 粗粒度 | 细粒度 |

| 计算成本 | 低 | 高 |

| 临床价值 | 快速筛查 | 手术规划、病灶量化 |

一句话总结:分类回答“是什么病”,定位回答“病在哪里”,分割回答“病的边界有多精确” 。

五、代码示例:从DICOM到AI推理的完整流程

步骤一:DICOM医学影像读取

DICOM(Digital Imaging and Communications in Medicine,医学数字成像与通信标准)是医学影像的存储格式,封装了像素矩阵与丰富的元数据(患者信息、设备参数等)-29。以下是用Python和pydicom库读取DICOM文件的核心代码:

import pydicom import numpy as np 读取DICOM文件 dicom_file = pydicom.dcmread("chest_xray.dcm") image_array = dicom_file.pixel_array 提取像素矩阵 patient_id = dicom_file.PatientID 提取患者元数据 预处理:归一化到[0, 1]区间 image_normalized = image_array / np.max(image_array)

步骤二:构建基于DenseNet121的AI诊断模型

以下是简化版的多标签分类模型构建代码(基于PyTorch框架):

import torch import torch.nn as nn from torchvision import models class ChestXRayAI(nn.Module): def __init__(self, num_classes=14): super(ChestXRayAI, self).__init__() 加载预训练的DenseNet121作为骨干网络 self.backbone = models.densenet121(pretrained=True) 替换分类头,适配14种疾病的二分类输出 in_features = self.backbone.classifier.in_features self.backbone.classifier = nn.Sequential( nn.Linear(in_features, 512), nn.ReLU(), nn.Dropout(0.2), nn.Linear(512, num_classes), nn.Sigmoid() 多标签输出,每个标签独立 ) def forward(self, x): return self.backbone(x) 模型实例化与推理 model = ChestXRayAI() model.eval() with torch.no_grad(): predictions = model(preprocessed_image) predictions shape: [1, 14]

步骤三:Grad-CAM生成热力图

为让AI的诊断具备可解释性,引入Grad-CAM技术生成病灶热力图:

def generate_gradcam(model, image, target_class): 获取模型的最后一个卷积层输出和分类层前的特征 features = model.backbone.features(image) 计算梯度并生成热力图 (实际实现需挂载hook获取梯度,此处展示核心逻辑) heatmap = compute_cam_weights(features, model.backbone.classifier) return overlay_heatmap(original_image, heatmap)

新旧对比:规则识别 vs AI学习

传统规则:人工定义几十条“if-else”判断逻辑,每个新设备新场景都要重新调参。

AI方案:模型从数万张标注胸片中自动学习特征,跨设备泛化能力强,且能持续迭代优化。

六、底层原理支撑

AI胸片诊断系统能够高效运行,底层依赖三大技术支柱:

1. 迁移学习与预训练:医疗影像数据标注成本极高,因此行业通行的做法是先在ImageNet等大规模自然图像数据集上预训练CNN,再在胸片数据上微调(Fine-tuning),利用已有知识快速适应新领域。

2. 联邦学习与隐私保护:Ark+等前沿模型支持联邦学习架构,允许多个医疗机构在不共享原始患者数据的前提下,协同训练模型,同时满足医疗数据隐私合规要求-10。

3. 自监督学习的新范式:2026年1月发布的AFLoc模型不再依赖人工标注的“标准答案”,而是同时学习胸片图像和对应的临床报告,通过“看图读报告”的方式自行理解病灶与影像区域的对应关系,从根本上降低了对昂贵人工标注的依赖-1。

七、高频面试题与参考答案

Q1:CNN在医学影像分类中为什么比传统机器学习效果好?

参考答案:传统方法依赖人工设计的特征(如HOG、SIFT),对医学影像中复杂的病灶形态表达能力有限。CNN通过端到端学习,自动从原始像素中提取从边缘到语义的多层次特征,并且具备平移不变性和局部连接特性,天然适合处理图像数据。在胸片诊断中,DenseNet等架构还能通过特征复用减轻梯度消失问题。

Q2:分类、检测、分割三个任务在医疗影像中的区别是什么?

参考答案:分类判断图像中是否存在某类疾病;检测输出病灶的边界框(Bounding Box),回答“病在哪里”;分割则输出像素级掩码,精确勾勒病灶轮廓。三者粒度依次递增,临床场景各不相同——快速筛查用分类,精准定位用分割。

Q3:如何解决医学影像数据标注不足的问题?

参考答案:常用策略包括:①数据增强(旋转、缩放、添加噪声等);②迁移学习,在ImageNet预训练基础上微调;③半监督/自监督学习,如AFLoc通过同时学习影像与临床报告实现零标注学习;④联邦学习,多中心联合训练不共享原始数据。

Q4:AI诊断模型在实际临床中的准确率能达到多少?

参考答案:以肺炎检测为例,meta分析显示AI模型综合灵敏度约88%、特异度约90%,AUC接近0.95,与放射科医生水平相当-69。作为“第二阅片人”,AI能将医生检测肺结节的灵敏度提升约9-10个百分点-69。在气胸检测中,AI辅助使医生平均诊断准确率相对提升23.15%-。

八、结尾总结

回顾全文,我们依次拆解了AI胸片诊断的技术链条:从传统人工阅片的效率与准确率痛点出发,引出以CNN为核心引擎的深度学习方案,厘清了分类、检测、分割三类任务的本质区别,提供了从DICOM读取到模型推理的完整代码示例,并揭示了迁移学习、联邦学习和自监督学习三大底层技术支柱。核心记忆点:分类定病种,分割定边界,Grad-CAM给答案。下一步可以深入多模态融合方向——当胸片诊断结合患者病历文本、实验室检验数据甚至基因组信息,AI辅助诊断将迈入更全面的智能决策时代。

参考文献

王珊珊团队.AFLoc: 自监督病灶定位模型.《自然·生物医学工程》, 2026.-1

Paulius Bundza et al.MCADS: Multi-label Chest Abnormality Detection System. Diagnostics, 2026, 16(4): 585.-2

邱云飞等.结合自注意力与卷积的胸部X光片疾病分类研究.《激光与光电子学进展》, 2024.-19

Diaz Angulo C et al.Performance Comparison of Gleamer ChestView. J Imaging Inform Med, 2025.-66

Anas A Haq et al.RadJEPA: Radiology Encoder for Chest X-Rays. arXiv:2601.15891, 2026.-8

DongAo Ma et al.Ark+: A fully open AI foundation model applied to chest radiography. Nature, 2025.-10