给宝宝、品牌或产品起一个既好听又有意义的名字,是许多人都会遇到的难题。起名看似简单,实则涉及文化底蕴、音韵美感、个性化偏好等多个维度。而起名AI助手正是为解决这一“创意困境”而生的技术产物——它依托自然语言处理和深度学习模型,在短短几秒内就能生成成百上千个符合特定要求的高质量候选名-1。为什么这一技术正成为AI应用领域的核心高频场景?因为它完美结合了自然语言理解、生成式AI、文化适配和个性化推荐等多个热门技术方向,是初学者理解大语言模型应用、进阶者掌握RAG与提示工程的绝佳实践案例。

许多开发者在学习起名AI助手时普遍存在“只会用、不懂原理”的痛点:知道怎么调用大模型API生成名字,却搞不清背后的大语言模型是如何工作的;或者知道用提示词约束风格,却混淆了条件生成模型和通用文本模型的核心区别。本文将从零到一拆解起名AI助手的技术全貌——从传统起名方案的痛点切入,讲解大语言模型与条件生成模型的核心概念与关系,提供可直接运行的代码示例,剖析底层大语言模型原理,最后总结高频面试题,帮你建立完整的知识链路。

一、痛点切入:为什么需要起名AI助手?

在AI起名工具普及之前,传统起名方案主要有两种。第一种是依赖人工翻阅古籍、字典或请教长辈,效率低且结果难以量化评估。第二种是早期的起名网站,其技术架构极其简单:一个庞大的姓名数据库(通常是静态的MySQL表)搭配基础的关键词,系统只能做精确匹配和简单组合-50。

早期起名网站的简单实现——数据堆砌模式 class TraditionalNaming: def __init__(self): 静态姓名数据库,只能做组合,没有“理解”能力 self.surnames = ["李", "王", "张", "刘", "陈"] self.male_names = ["强", "伟", "勇", "军", "杰"] self.female_names = ["芳", "娜", "敏", "静", "丽"] def generate_name(self, surname, gender): if gender == "男": base_names = self.male_names else: base_names = self.female_names 纯随机组合,无法理解用户偏好和文化内涵 return surname + random.choice(base_names) 生成结果:李强、王芳、张伟……千篇一律

这种传统方案至少有三大致命缺陷:

耦合高:数据库、筛选逻辑、结果展示全部耦合在一起,想扩展“音律分析”或“五行匹配”等新功能几乎要重写整个系统。可扩展性差:数据库是静态的,新增一个名字需要手动更新表,无法自动学习命名趋势。缺乏个性化理解:系统完全不懂语义,无法根据用户输入的“希望名字有诗意”“要出自《诗经》”这类抽象要求做出响应,所有生成结果千篇一律-50。

这恰恰是起名AI助手要解决的核心问题——让机器真正“理解”命名需求,并“创作”出符合文化审美和个性化要求的名字。

二、核心概念一:大语言模型

大语言模型(Large Language Model, LLM) 是一类基于海量文本数据训练而成的深度学习模型,具备理解、生成和处理自然语言的能力。其核心运作逻辑是:通过分析训练数据中的语言模式,预测给定上下文中最可能出现的下一个词或句子。

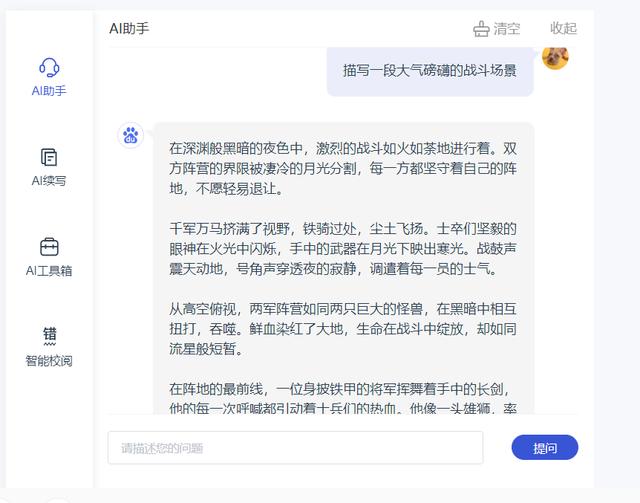

用类比来理解:大语言模型就像一个读过全世界所有书籍的超级学霸。你给它一个开头“这是一首描写春天的诗”,它能根据自己读过的无数诗歌样本,续写出“春风拂面柳如烟”这样的句子。起名场景中,你输入“需要一款科技公司的品牌名”,大语言模型就会从海量品牌命名数据中提取规律,输出如“云栖科技”“智联未来”等候选方案-35。

大语言模型解决了传统方案的“理解缺失”问题——它不是在做数据库匹配,而是在做基于概率的语义生成,能够理解用户的抽象意图并创造新的名字。

三、核心概念二:条件生成模型

条件生成模型(Conditional Generative Model) 是大语言模型的一个变种,它在训练时被注入了额外的约束条件,使生成结果能够严格遵循用户的指定要求。通俗地说,标准大语言模型是一个“自由写作者”,而条件生成模型是一个“命题创作者”——你给它规定了长度、风格、必须包含的字词等条件,它就会在这些边界内进行创作-35。

起名AI助手核心逻辑:基于条件生成模型的实现原理 def ai_naming_assistant(surname, gender, style, must_contain=None): 构建约束条件——这是条件生成模型的核心 prompt = f""" 请为一位姓"{surname}"的{gender}宝宝起名,要求如下: - 风格:{style} - 名字必须是双字(姓+单名)或三字(姓+双名) - 寓意积极向上 """ if must_contain: prompt += f"- 名字中必须包含'{must_contain}'字\n" prompt += "请生成5个候选名,并解释每个名字的寓意。" 调用大语言模型API(实际应用中替换为具体模型接口) response = call_llm(prompt, temperature=0.8) return response 调用示例 result = ai_naming_assistant("林", "女", "诗意古风", must_contain="月") 可能输出:林月清(明月清辉)、林月华(月华如练)等

大语言模型与条件生成模型的关系可概括为:大语言模型是“能力底座”,条件生成模型是“使用方式”。前者提供了理解和生成语言的基础能力,后者通过提示工程(Prompt Engineering)将这些能力约束到具体任务边界内。起名AI助手本质上是“大语言模型能力 + 条件生成约束 + 领域知识(音律、寓意、重名率等)”的组合。

四、概念关系与区别总结

| 维度 | 大语言模型 | 条件生成模型 |

|---|---|---|

| 核心定位 | 基础能力层,提供语言理解和生成 | 应用约束层,将能力聚焦到特定任务 |

| 是否受约束 | 无约束,根据上下文自由生成 | 有约束,必须满足指定条件 |

| 训练数据 | 通用文本(百科、书籍、网页等) | 通用文本 + 任务特定标注数据 |

| 起名场景表现 | 可能生成“李科技”“王AI”这类抽象组合 | 能够生成“李沐宸”“王悠然”等符合审美的名字 |

| 实现方式 | 大规模预训练(Pre-training) | 微调(Fine-tuning)或提示工程 |

一句话记忆:大语言模型是“什么都会”的通才,条件生成模型是“专精某领域”的专家,起名AI助手就是用提示词把通才“变”成专家的过程。

五、代码示例:从零构建起名AI助手

下面用极简代码展示起名AI助手的核心逻辑,使用提示工程(Prompt Engineering)来约束大语言模型的输出:

起名AI助手完整示例(基于OpenAI API) import openai import json class NamingAIAssistant: def __init__(self, api_key, model="gpt-3.5-turbo"): openai.api_key = api_key self.model = model def generate_names(self, surname, gender, style, count=5): 关键:精心构造的条件约束提示词 prompt = f""" 你是一位专业的起名AI助手。请为一位姓"{surname}"的{gender}宝宝起{count}个名字。 必须遵循以下条件约束: 1. 名字的整体长度:2-3个字(包括姓氏) 2. 风格要求:{style} 3. 避免常见名字(如“李伟”“张强”等) 4. 每个名字需附上寓意解释 请以JSON格式输出: {{ "names": [ {{"name": "名字", "meaning": "寓意解释"}}, ... ] }} """ response = openai.ChatCompletion.create( model=self.model, messages=[{"role": "user", "content": prompt}], temperature=0.8, 控制创造性,0~1之间,越大越有创意 max_tokens=500 ) result = json.loads(response.choices[0].message.content) return result["names"] 使用示例 assistant = NamingAIAssistant(api_key="your-api-key") names = assistant.generate_names("林", "女", "诗意古风,出自《诗经》") for item in names: print(f"{item['name']} —— {item['meaning']}") 输出示例: 林清如 —— 取自《诗经》“清扬婉兮”,寓意清澈温婉 林采薇 —— 源自“采薇采薇”,象征坚韧与自然之美

关键步骤解读:

步骤1:定义类

NamingAIAssistant,封装调用逻辑步骤2:构造提示词(Prompt),明确输出格式(JSON),这是条件约束的核心体现

步骤3:设置

temperature=0.8,平衡创造性和可控性步骤4:解析JSON输出,提取名字和寓意

与传统方案相比,改进是质的飞跃:不再依赖静态数据库做简单组合,而是通过提示词让大语言模型真正“理解”用户需求并“创作”出有文化内涵的名字。整个流程从“数据查询”变成了“语义生成”。

六、底层原理:大语言模型的技术支撑

起名AI助手之所以能“理解”并“创作”名字,底层依赖的是大语言模型的核心技术——Transformer架构。

2017年,Google团队在论文《Attention Is All You Need》中首次提出了Transformer架构。它彻底抛弃了传统的循环神经网络(RNN)设计,完全基于自注意力机制(Self-Attention) 构建-25。RNN在处理长文本时会像“传话游戏”一样逐词传递信息,导致序列开头的信息逐渐丢失;而Transformer一次性处理整个序列,用注意力机制计算所有词之间的相关性,从根本上解决了长距离依赖问题-25。

自注意力机制的核心思想是:在理解一个词时,让模型同时关注句子中的其他所有词,并计算它们之间的关联程度。它通过三个向量来实现——Query(查询) 表示“当前词想找什么信息”,Key(键) 表示“其他词包含什么信息”,Value(值) 表示“信息的实际内容”-25。为了让模型能从不同角度理解语义,Transformer还引入了多头注意力(Multi-Head Attention) ,让模型同时从语法、语义、情感等多个维度学习信息-23。

在此基础上,现代大语言模型通过在海量数据上进行预训练,学会了语言的统计规律和文化知识。当我们用提示词调用时,模型将这些知识迁移到起名任务中,生成符合要求的名字。这一技术路径的实现得益于:大规模GPU/TPU集群支撑的分布式训练、参数高效微调技术(如LoRA)以降低适配成本、以及RAG(检索增强生成)等技术来补充外部知识源-20。

七、高频面试题与参考答案

Q1:大语言模型和条件生成模型有什么区别?

参考答案:大语言模型是经过海量通用文本预训练的模型,具备基础的语言理解和生成能力,但生成结果不受特定约束限制。条件生成模型是大语言模型的一种应用形式,通过微调或提示工程在生成过程中施加额外约束(如长度限制、风格偏好等),使输出结果符合特定任务要求。简言之,前者提供能力底座,后者实现任务聚焦。

Q2:Transformer为什么比RNN更适合处理长文本?

踩分点:①RNN串行处理+梯度消失;②Transformer并行处理+自注意力。

标准答案:RNN需要顺序处理序列中的每个词,无法并行计算,且当序列变长时容易产生梯度消失问题,导致长距离信息丢失。而Transformer采用自注意力机制,可以一次性并行计算序列中所有词之间的关联,不存在信息传递衰减问题。同时,并行处理能力使得Transformer能够在大规模GPU集群上高效训练,支撑起千亿级参数的大模型。

Q3:如何让AI起名助手生成的名字具有文化内涵(如出自《诗经》)?

参考答案:主要有三种方法。一是提示工程,在提示词中明确要求“参考《诗经》原文”并给出示例;二是微调,用标注了出处的古典文献数据对模型进行领域适配;三是RAG(检索增强生成),在生成前从知识库中检索相关典籍内容作为上下文注入,让模型基于真实文献进行创作。Dify等平台已支持这种“知识库+大模型”的混合方案。

Q4:起名AI助手的主要技术挑战有哪些?

参考答案:①创意与可控性的平衡——temperature参数过低结果单调,过高输出不可控;②重名与合规问题——需要接入外部数据库进行查重和敏感词过滤;③多维度评估——名字的优劣涉及音韵、字形、寓意等多个难以量化的维度,构建自动化评分体系有挑战;④推理延迟与成本——大模型推理有延迟,规模化使用API成本较高,通常需要引入缓存和提示词优化策略。

Q5:简述大语言模型的预训练(Pre-training)与微调(Fine-tuning)的区别。

参考答案:预训练是在海量通用文本上进行的无监督学习阶段,目标是让模型掌握语言的基础规律和知识,训练成本极高。微调是在预训练模型基础上,用特定领域的标注数据做进一步训练,使模型适配下游任务(如起名),只需少量数据和较短的训练时间。当前主流做法是“预训练基座模型 + 微调适配具体任务”。

八、结尾总结

本文围绕起名AI助手这一核心技术场景,系统梳理了四大要点:

痛点分析:传统起名方案存在耦合高、扩展性差、缺乏语义理解等问题,起名AI助手通过大语言模型技术从根本上解决了这些缺陷。

核心概念:大语言模型是能力底座,条件生成模型是通过微调或提示工程约束输出结果的具体应用方式。

代码实战:通过提示工程将大语言模型约束为专业的起名AI助手,代码简洁且可运行。

底层原理:Transformer架构及其自注意力机制是大语言模型的核心技术支撑,实现了并行计算和长距离语义捕捉。

重点提醒:不要混淆“大语言模型”和“条件生成模型”——前者是“能力”,后者是“用法”。理解了这一层,你就掌握了起名AI助手乃至整个生成式AI应用的本质:用约束条件(提示词/微调)把通用大模型的“无限可能”转化为具体任务的“精准输出”。

下一篇我们将深入讲解RAG技术如何让AI起名助手真正“引经据典”,以及如何构建完整的起名系统技术栈。欢迎持续关注!